-

1 дифференциальная энтропия условного распределения вероятностей

дифференциальная энтропия условного распределения вероятностей

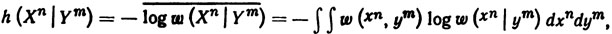

Мера неопределенности условного распределения вероятностей непрерывной случайной величины при условии, что задано значение другой непрерывной случайной величины, усредненная по значениям последней; ее выражение имеет вид

где w(xn, ym)=w(x1,..., xn, y1,..., ym) - совместная плотность распределения вероятностей случайных величин Хn = (Х1,..., Хn) и Ym = (Y1,..., Ym), w(xn|ym)= w(x1,..., xn | y1,..., ym) — условная плотность распределения вероятностей случайной величины Хn при условии, что задано значение уm случайной величины Уm; интегрирование ведется по всему множеству значений xn, ym, случайных величин Xn, Ym.

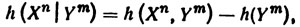

Примечание. Имеет место равенство

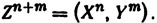

где h(Xn, Ym) —дифференциальная энтропия случайной величины

.

.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > дифференциальная энтропия условного распределения вероятностей

-

2 дифференциальная энтропия условного распределения вероятностей

General subject: differential conditional-probability-distribution entropy (мера неопределенности условного распределения вероятностей непрерывной случайной величины при условии, что задано значение друго)Универсальный русско-английский словарь > дифференциальная энтропия условного распределения вероятностей

См. также в других словарях:

Maximum entropy probability distribution — In statistics and information theory, a maximum entropy probability distribution is a probability distribution whose entropy is at least as great as that of all other members of a specified class of distributions. According to the principle of… … Wikipedia

probability theory — Math., Statistics. the theory of analyzing and making statements concerning the probability of the occurrence of uncertain events. Cf. probability (def. 4). [1830 40] * * * Branch of mathematics that deals with analysis of random events.… … Universalium

Entropy (information theory) — In information theory, entropy is a measure of the uncertainty associated with a random variable. The term by itself in this context usually refers to the Shannon entropy, which quantifies, in the sense of an expected value, the information… … Wikipedia

Differential entropy — (also referred to as continuous entropy) is a concept in information theory that extends the idea of (Shannon) entropy, a measure of average surprisal of a random variable, to continuous probability distributions. Contents 1 Definition 2… … Wikipedia

Cauchy distribution — Not to be confused with Lorenz curve. Cauchy–Lorentz Probability density function The purple curve is the standard Cauchy distribution Cumulative distribution function … Wikipedia

Dirichlet distribution — Several images of the probability density of the Dirichlet distribution when K=3 for various parameter vectors α. Clockwise from top left: α=(6, 2, 2), (3, 7, 5), (6, 2, 6), (2, 3, 4). In probability and… … Wikipedia

дифференциальная энтропия условного распределения вероятностей — Мера неопределенности условного распределения вероятностей непрерывной случайной величины при условии, что задано значение другой непрерывной случайной величины, усредненная по значениям последней; ее выражение имеет вид где w(xn, ym)=w(x1, ...,… … Справочник технического переводчика

Multivariate normal distribution — MVN redirects here. For the airport with that IATA code, see Mount Vernon Airport. Probability density function Many samples from a multivariate (bivariate) Gaussian distribution centered at (1,3) with a standard deviation of 3 in roughly the… … Wikipedia

Information theory — Not to be confused with Information science. Information theory is a branch of applied mathematics and electrical engineering involving the quantification of information. Information theory was developed by Claude E. Shannon to find fundamental… … Wikipedia

List of mathematics articles (C) — NOTOC C C closed subgroup C minimal theory C normal subgroup C number C semiring C space C symmetry C* algebra C0 semigroup CA group Cabal (set theory) Cabibbo Kobayashi Maskawa matrix Cabinet projection Cable knot Cabri Geometry Cabtaxi number… … Wikipedia

Quantities of information — A simple information diagram illustrating the relationships among some of Shannon s basic quantities of information. The mathematical theory of information is based on probability theory and statistics, and measures information with several… … Wikipedia